2026程序员生存指南:从GitHub Copilot的“翻车”现场到Kaggle夺冠,深度解密AI结对编程

小葵API服务 的 AI API 使用建议

小葵API服务 面向需要 OpenAI 兼容接口、Claude/Gemini/GPT 多模型切换、包月额度管理和图像模型调用的用户。阅读本文后,可以结合本站的模型清单、独立使用文档和个人面板,把教程内容直接落到实际调用流程中。

引言:结对编程的“新伙伴”

在软件开发领域,开发者通常被分为两类:外向的“社交型”和内向的“独行侠”。对于后者来说,传统的“结对编程(Pair Programming)”往往是一场噩梦。然而,随着2026年大语言模型(LLM)的爆发,一个不需要社交、24小时待命的“编程伙伴”似乎成了完美的替代方案。

但现实真的如此美好吗?从Hackaday开发者的愤怒吐槽,到NVIDIA团队在Kaggle竞赛中的大获全胜,2026年的AI编程正呈现出一种极端的“两极分化”。

现实的骨感:当Copilot遇上嵌入式开发

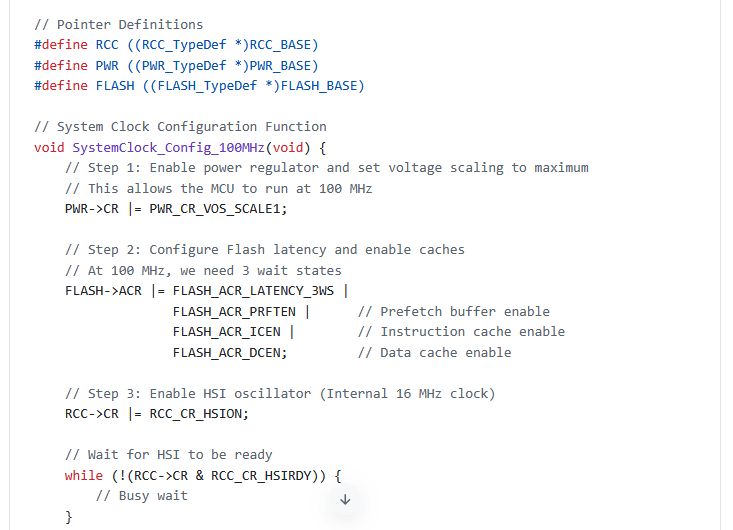

许多开发者在初次尝试AI结对编程时,往往会遭遇挫折。以STM32嵌入式开发为例,开发者Maya Posch在尝试使用GitHub Copilot配置STM32F411的时钟频率时,体验几乎是灾难性的。

1. “货不对板”的代码生成

虽然开发者明确要求使用CMSIS标准,但AI却频繁提供ST HAL库的代码。即便在强行修正后,AI生成的代码竟然为了避开头文件引用,直接将大量的结构体定义硬编码到文件中,导致代码极其臃肿。

2. 致命的逻辑错误

最令专家无法接受的是“幻觉”导致的错误。例如,AI生成了根本不存在的宏定义 PWR_CR_VOS_SCALE1。对于嵌入式系统,这种错误不仅无法编译,甚至可能导致硬件运行异常。由于这种低级的逻辑偏差,原本旨在提高效率的AI反而成了需要反复检查的“负担”。

进阶之路:Kaggle夺冠背后的工作流秘籍

既然AI会“翻车”,为什么NVIDIA的专家却能利用它赢得Kaggle竞赛?答案在于从“对话式搜索”向“工作流驱动”的转变。

在2026年3月的Kaggle电信客户流失预测比赛中,Chris Deotte通过引导三个LLM智能体(GPT-5.4 Pro、Gemini 3.1 Pro、Claude Opus 4.6),生成了超过60万行代码,运行了850次实验,最终夺得第一名。

他们的成功路径可以概括为以下四个步骤:

- 自动化数据探索(EDA): 让智能体主动编写并运行代码,理解数据集的行、列、目标值及缺失情况。

- 构建基准模型: 快速生成XGBoost或神经网络的初始管道。

- 迭代特征工程: 这是AI最擅长的领域。通过GPU加速库(如NVIDIA cuDF),AI可以极速测试数百种特征组合。

- 模型集成(Stacking): 利用AI将数百个模型通过“爬山算法”组合成一个强大的四层堆叠架构。

2026年AI编程的三大核心趋势

根据最新行业分析,2026年4月的AI生态正经历前所未有的范式转移:

1. 从“Copilot”向“自主执行系统”进化

过去,AI只是代码自动补全插件;现在,**编码智能体(Coding Agents)**已能理解整个代码库、重构大型项目并自动创建Pull Request。开发者正在从“写每一行代码”转变为“指导并评审智能体”。

2. 多智能体协作取代线性流

不再是简单的“输入→响应”,现代架构采用多智能体协作:计划智能体负责规划,执行智能体编写代码,验证智能体检查错误。这种模块化设计极大提升了复杂任务的可靠性。

3. 基础设施级的压缩与效率

随着上下文窗口(Context Window)的不断扩大,Google推出的TurboQuant技术可实现KV缓存高达6倍的压缩,这意味着更小的硬件也能处理超长文档的推理,显著降低了推理成本。

总结:如何避免被AI“带偏”?

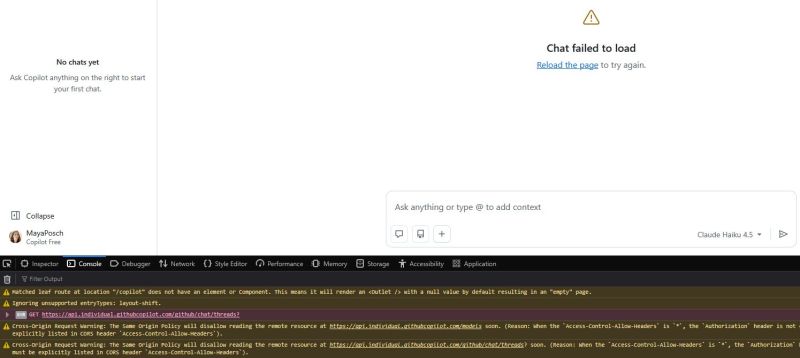

结对编程与AI结合的真谛不在于完全替代思考,而在于模型选择与Prompt工程的精准度。Maya的失败部分归因于使用了较低版本的模型(如Claude Haiku),而Chris的成功则源于顶尖模型与严格工作流的配合。

作为2026年的开发者,与其纠结AI是否会取代人类,不如学会如何成为一名优秀的“AI架构师”——在保持批判性思维的同时,利用自主执行系统加速那些枯燥的重复劳动。毕竟,在代码的世界里,工具的好坏往往取决于握住工具的那双手。