2026年AI编程大爆发:从“助手”走向“自主代理”的现实与挑战

小葵API服务 的 AI API 使用建议

小葵API服务 面向需要 OpenAI 兼容接口、Claude/Gemini/GPT 多模型切换、包月额度管理和图像模型调用的用户。阅读本文后,可以结合本站的模型清单、独立使用文档和个人面板,把教程内容直接落到实际调用流程中。

引言:编程新纪元的到来

站在2026年的时间点回望,人工智能在软件开发领域的应用已经发生了质的飞跃。我们正在经历从“对话式助手(Chatbots)”到“自主执行系统(Autonomous Execution Systems)”的巨大转变。然而,在技术狂热的背后,开发者们也面临着代码质量、幻觉风险以及日益严格的法律监管等多重挑战。

一、 2026年AI编程的十大核心趋势

根据行业最新的观察,AI生态系统正变得越来越复杂且专业化。以下是重塑软件开发流程的关键趋势:

- 编码代理进化为“全栈工程师”:现代代理(Agents)不再仅仅是补全代码片段,它们已经能够理解整个代码库,自主重构大型代码库、创建PR、运行测试并端到端地调试问题。

- TurboQuant与KV缓存压缩:为了应对长上下文处理中的内存瓶颈,谷歌推出的TurboQuant技术可将推理时的内存开销降低约6倍,使模型在处理超长代码会话时更加高效。

- 多代理系统(Multi-Agent Systems):线性的“输入-响应”模式正被规划、研究、执行和验证等多个专项代理组成的协同网络所取代。

- 终端优先的工作流:开发者正从浏览器聊天界面回归终端,使用CLI驱动的代理和深度集成的Shell AI。

- 专业化推理模型:AI模型开始分化,一类追求极速响应,另一类则专注于深度数学逻辑和复杂代码分析。

二、 理想与现实的碰撞:GitHub Copilot的实战“翻车”记录

尽管技术趋势令人振奋,但在实际的嵌入式开发等硬核领域,AI的表现依然可能让人抓狂。开发者Maya Posch最近分享了她尝试使用GitHub Copilot进行STM32 C++开发的“惨痛”经历。

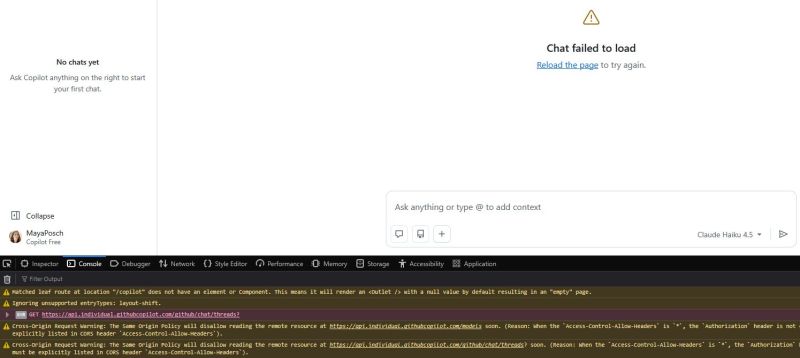

1. 服务的不可靠性

Maya发现,与人类结对编程伙伴不同,AI助手可能会随时“罢工”。在实验初期,由于GitHub系统故障,Copilot Chat直接报错无法加载。对于依赖AI工作流的团队来说,这种中心化服务的稳定性是一个巨大的隐患。

2. 库的混淆与“幻觉”代码

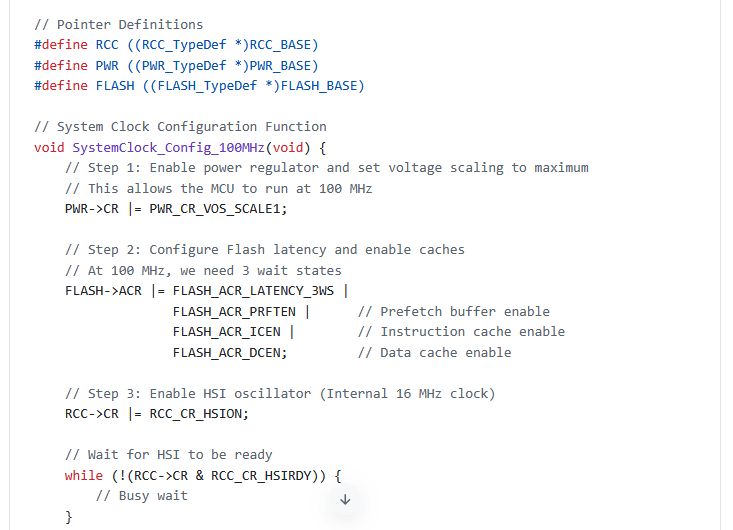

当被要求提供基于CMSIS标准的STM32F411时钟配置代码时,Copilot的表现差强人意:

- 库混淆:尽管明确要求使用CMSIS,AI却吐出了大量ST HAL库的代码。

- 代码冗余:它没有正确使用宏定义和头文件,而是将整个结构体定义直接硬编码到输出中。

- 严重的逻辑错误:最致命的是,AI生成的电压调节器(VOS)缩放代码在目标硬件上根本无法运行,甚至引用了不存在的宏。

这表明,虽然AI在处理Web开发等流行语言时如鱼得水,但在资源受限、硬件关联度高的专业领域,它的“氛围编程(Vibe Coding)”往往会产生不可靠的“代码垃圾”。

三、 监管哨声响起:欧盟AI法案的合规性大考

到2026年8月2日,欧盟AI法案(EU AI Act)将正式实施。对于将AI工具集成到开发流程中的企业来说,合规性已不再是可选项。

哪些情况属于“高风险”?

如果你的AI编码工具涉及以下场景,可能被归类为高风险系统:

- 就业触发:使用AI评估开发者生产力、对工程师进行排名或分配任务。

- 关键基础设施:自主部署到电网、金融系统或医疗设备的工具。

- 构建高风险软件:如果开发者正在构建医疗器械等受监管软件,那么所使用的AI编码工具也必须符合严格的审计和文档要求。

热门工具的合规性扫描

目前的市场主流工具在合规性上表现不一:

- OpenAI Codex:提供不可篡改的JSONL审计日志,最符合企业采购的审计需求。

- Claude Code:支持在Git提交中原生添加AI作者身份标签(Co-authored-by),提供了极佳的溯源性。

- Intent:采用“规格即文档”架构,在代理执行任务的同时自动生成符合法规的合规记录。

- Cursor 3 / Antigravity:虽然在生产力上表现卓越,但在导出管理审计轨迹方面仍存在短板,在受监管环境部署时需加装“包装层”。

四、 开发者如何应对:从“写代码”到“导演代码”

面对2026年的AI浪潮,开发者应如何自处?

- 保持批判性思维:正如Maya的实验所示,AI输出并非真理。开发者必须具备深厚的底层知识(如查阅芯片手册的能力),才能识别AI的隐蔽错误。

- 建立合规审计流:不要等到监管截止日期才开始考虑。确保你的AI生成的每一行代码都有可追溯的审计线索,明确哪些是AI写的,哪些经过了人类复核。

- 掌握“指令工程”之外的架构能力:在自主代理时代,最重要的不再是写Prompt,而是如何定义系统的规格(Spec)和边界。正如Intent等工具所展示的,高质量的规格说明书将成为AI执行的指南针。

结语

2026年的AI编程工具不再是神奇的黑盒子,而是需要精细管理和严格审计的工程辅助系统。虽然像GitHub Copilot这样的工具在专业领域仍有反复,但随着TurboQuant等优化技术和欧盟法案等治理框架的成熟,AI与人类开发者的协作将变得更加科学与透明。你是选择在这场浪潮中“认知缴械”,还是拿起这些利刃成为更强大的代码导演?